since 2003

イレコナビ サイトマップ

2024年末までに、人工知能AIの活用を推進しようとする動きが活発化している。

敵の手口的な観点からは、AIには、次のような問題点がある。

・ 悪魔祓い霊能者や精神科医の後任者としてAIが使われ得る。

・ AIの判断が正しいのか間違っているのかをAI内のログを見てチェックする事ができない。

・ 生成AIが著作権などの知的所有権を侵害する恐れがある。

・ AIが出した結果なんだとうそをついて、人が自分の意見を信用させる犯罪が懸念される。

・ 言ってる事が正しいか否かを聞いた人が内容から直に判断するのではなく、誰が言ってるかで判断する悪いクセを流行させる事が目指されているのではないか。

AIが言ってるんなら正しいだろう、という判断の仕方が普及すれば、最初は、AIが出した結果として人知を超える正しい事をたくさん見せて人々を驚かせ、そのあとで、AIが出した結果なんだと嘘をついたり、偏った判断をする様に設計された不正なAIが出した結果を人々に信じさせる、という犯罪が台頭して来るに違いない。

敵は、最初からそれを目的としてAIの活用の推進を急いでいるだろう。

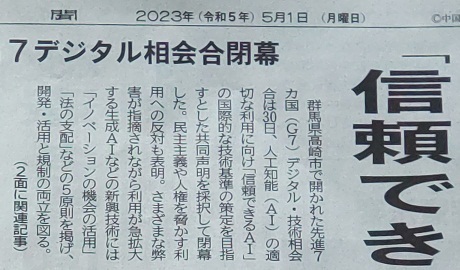

2023年05月01日の新聞に、AIを信頼しようとする動きが有る事が書かれていた。

-----------

2023年頃に話題に成っているAIというのは、ディープラーニングと呼ばれる方式のAIで、これは人間の脳の働きを模倣したと言われている。

例えば、経験に基づいて、過去に自分に対して嘘をついた人の顔を総合すると、どんな特徴を持っていた、それに基づいて新しく出会った人が嘘つきか否かを予想する、といったような物です。

この様な方式のAIが信頼される様に成って来ている事は、自分の置かれている状況を警戒が必要な状況だとする判断を被害妄想だと認定して来た態度が故意の欺瞞である証拠だと見なせる。

どこがどうだから警戒が必要なのか説明できないから被害妄想だと言って来たわけだが、ディープラーニング方式のAIも、どうしてその顔が嘘つきの顔なのかを説明は出来ないのである。

そういう、人間の脳の機能には判断のプロセスを説明できない判断をする事も含まれており、そういう判断も信頼できると誰もが最初から考えている事の証拠、そういう判断は不合理・非科学的な判断であると主張して来た事が悪質なシラバックレであった事の証拠が、ディープラーニング方式のAIの近年ももてはやしぶりなのである。